Jak działa aparat w smartfonie? Od fotodiody do gotowego zdjęcia

Smartfon w kieszeni zastąpił już większość kompaktowych aparatów. Ale jak ten cienki sensor zamienia światło na miliony polubień na Instagramie? Wyjaśniamy cały proces - od soczewki przez procesor obrazu, aż po gotowe zdjęcie.

Tomasz Jankowski

Ekspert sprzętu mobilnegoEntuzjasta fotografii mobilnej i elektroniki użytkowej. Testuje smartfony i dzieli się praktyczną wiedzą o hardware.

Opublikowano: 3 kwietnia 2026 · Zaktualizowano: 4 kwietnia 2026

Współczesny smartfon to nie tylko telefon i przeglądarka internetowa. To również najpopularniejszy aparat fotograficzny na świecie.

Według badań, ponad 90 procent zdjęć wykonywanych dziś powstaje właśnie za pomocą telefonów komórkowych.

Ale jak to możliwe, że urządzenie o grubości kilku milimetrów robi zdjęcia porównywalne z dedykowanymi aparatami? Odpowiedź tkwi w synergii optyki, elektroniki i sztucznej inteligencji.

W tym artykule prześledzimy całą drogę światła. Od obiektywu, przez sensor, aż po finalny plik zapisany w pamięci telefonu.

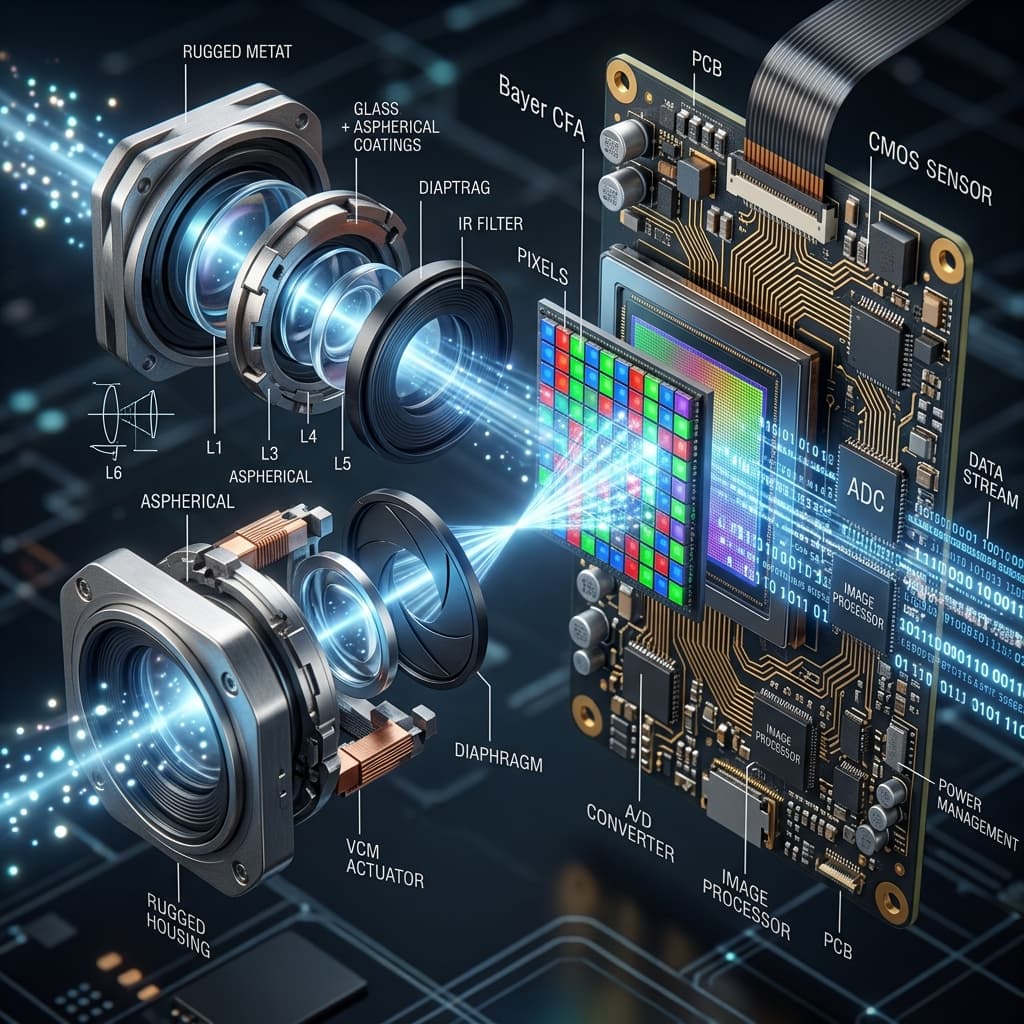

Od soczewki do sensora

Światło docierające do obiektywu smartfona musi przejść przez szereg soczewek, zanim trafi na sensor. W przeciwieństwie do dużych aparatów DSLR, smartfonowe moduły muszą zmieścić się w grubości od 5 do 10 milimetrów.

To wymaga niezwykłej precyzji inżynierskiej. Współczesne smartfony stosują soczewki asferyczne i pryzmatyczne, które łamią światło na najmniejszej możliwej przestrzeni.

Niektóre modele, jak Samsung Galaxy S23 Ultra, posiadają nawet soczewki z płynnymi soczewkami (Liquid Lens). Mogą one zmieniać kształt i ogniskową bez fizycznego przemieszczania elementów optycznych.

Inne, jak iPhone 15 Pro Max, wykorzystują tzw. tetraprismę. To układ czterech pryzmatów, który składa długą ogniskową w płaskiej obudowie.

Kiedy światło już dotrze do sensora, zaczyna się prawdziwa magia. Sensor to matryca milionów mikroskopijnych fotodiod, które zamieniają fotony na ładunki elektryczne.

Sensor CMOS - serce smartfonowego aparatu

Dominującą technologią w smartfonach jest sensor CMOS (Complementary Metal-Oxide-Semiconductor). Każdy piksel składa się z dwóch części: fotodiody, która zbiera światło, oraz tranzystorów, które odczytują powstały sygnał.

Wielkość sensora ma kluczowe znaczenie dla jakości zdjęcia. Im większy sensor, tym więcej światła może zebrać każdy piksel. To przekłada się na lepszą jakość w słabych warunkach oświetleniowych.

Poniższa tabela pokazuje porównanie typowych rozmiarów sensorów:

| Sensor | Przekątna | Główne zastosowanie | Przykłady modeli |

|---|---|---|---|

| 1/2,55" | ~5,8 mm | Podstawowe smartfony | Większość telefonów średniej półki |

| 1/1,7" | ~9,4 mm | Flagowce | iPhone 14 Pro, Samsung S23 |

| 1" | ~16 mm | Smartfony fotograficzne | Sony Xperia Pro-I, Xiaomi 13 Ultra |

| M4/3 | ~21,6 mm | Aparaty kompaktowe | Panasonic LX100, Olympus PEN |

Jak widać, nawet największe smartfonowe sensory są znacznie mniejsze niż te w profesjonalnych aparatach. Dlatego producenci telefonów muszą szukać innych sposobów na poprawę jakości.

Przede wszystkim w oprogramowaniu i sztucznej inteligencji.

Od surowych danych do kolorów

Surowy sygnał z sensora nie jest jeszcze zdjęciem, jakie widzisz na ekranie. Każdy piksel rejestruje tylko jeden kolor: czerwony, zielony lub niebieski. Dzieje się to zgodnie z układem filtra Bayer.

Proces łączenia tych monochromatycznych pikseli w pełnokolorowe zdjęcie nazywa się demozaikowaniem.

To zadanie wykonuje procesor obrazu, czyli ISP (Image Signal Processor). Współczesne smartfony, szczególnie te z flagowych serii, posiadają dedykowane ISP wbudowane bezpośrednio w układ SoC (System on Chip).

Przykłady to Apple Photonic Engine w iPhone'ach czy Snapdragon Sight w telefonach z procesorami Qualcomm.

ISP wykonuje w ułamku sekundy kilkanaście skomplikowanych operacji. Z których każda ma kluczowe znaczenie dla finalnego wyglądu zdjęcia:

Kluczowe operacje ISP

- Demozaikowanie - rekonstrukcja pełnego koloru z danych filtra Bayer. Algorytmy obliczają brakujące kolory dla każdego piksela na podstawie sąsiadów.

- Korekcja szumów - redukcja ziarna, szczególnie ważna przy słabym świetle. Szumy to przypadkowe zakłócenia sygnału, gdy sensor zbiera zbyt mało światła.

- Korekcja aberracji chromatycznej - usuwanie kolorowych obwódek wokół kontrastowych krawędzi. Powstają one w wyniku niedoskonałości optyki obiektywu.

- Balans bieli - dopasowanie temperatury barwowej. Dzięki temu białe obiekty wyglądają na białe niezależnie od źródła światła.

- Korekcja dystorsji - prostowanie zniekształceń wprowadzanych przez szerokokątny obiektyw. Szczególnie widocznych przy krawędziach kadru.

- HDR - łączenie kilku ekspozycji w jedno zdjęcie o dużym zakresie dynamiki. Dzięki temu zarówno cienie, jak i światła są dobrze widoczne.

- Ostrzenie i redukcja szumów - finalna obróbka detali, która podbija wyrazistość zdjęcia bez wprowadzania sztuczności.

Sztuczna inteligencja przejmuje stery

W ostatnich latach rola oprogramowania w fotografii mobilnej stała się tak samo ważna jak rola hardware'u. Producenci coraz częściej używają terminu "computational photography", czyli fotografii obliczeniowej.

Polega ona na łączeniu i przetwarzaniu wielu zdjęć przez algorytmy maszynowe. Celem jest uzyskanie efektu niedostępnego dla tradycyjnego aparatu.

Oto najważniejsze przykłady fotografii obliczeniowej:

Tryby fotografii obliczeniowej

- Night Mode - telefon robi serię krótkich zdjęć z różnymi parametrami, a potem łączy je w jedno. Efektem jest zdjęcie nocne wyglądające jakby było wykonane przy znacznie lepszym świetle.

- Portrait Mode - algorytmy rozpoznają kontur twarzy i sztucznie rozmywają tło. Symuluje to dużą przysłonę obiektywu z profesjonalnego aparatu.

- Deep Fusion / Smart HDR - systemy Apple łączące kilkanaście klatek w jedno zdjęcie o maksymalnej ilości detali. Każdy piksel jest analizowany osobno.

- Astrophotography Mode - w telefonach Google Pixel pozwala robić zdjęcia Drogi Mlecznej bez profesjonalnego sprzętu. Telefon zbiera światło przez kilka minut.

- Super Resolution - algorytmy tworzą zdjęcia o wyższej rozdzielczości niż fizyczna liczba pikseli sensora. Wykorzystują do tego mikroprzesunięcia kamery.

Dlaczego więcej megapikseli nie zawsze znaczy lepiej

Producenci smartfonów uwielbiają reklamować coraz większe liczby megapikseli. Znajdziemy już telefony z sensorami 200 MP.

Ale czy to naprawdę poprawia jakość zdjęć? Nie do końca.

W małym sensorze upchanie 200 milionów pikseli oznacza, że każdy z nich jest mikroskopijny. Zbiera bardzo mało światła.

W praktyce telefon łączy sąsiednie piksele w grupy (np. 16 w 1). Dzięki temu uzyskuje efektywnie zdjęcie o mniejszej, ale lepszej jakościowej rozdzielczości.

Dlatego zdjęcie z 200 MP sensora często wygląda najlepiej w trybie 12 MP. Ważniejsze od samej liczby megapikseli są inne czynniki:

Co naprawdę decyduje o jakości

- Wielkość pojedynczego piksela - im większy piksel, tym więcej światła zbiera. To przekłada się na lepszą jakość przy słabym oświetleniu i mniejszą ilość szumów.

- Jakość optyki - soczewki bez aberracji i z dobrym pokryciem kadru są kluczowe. Nawet najlepszy sensor nie pomoże, jeśli światło dociera przez niedoskonałe szkło.

- ISP i algorytmy - to one w dużej mierze decydują o finalnym wyglądzie zdjęcia. Ten sam sensor w dwóch różnych telefonach może dawać zupełnie inne rezultaty.

- Stabilizacja obrazu - optyczna stabilizacja (OIS) lub sensor-shift redukują drgania rąk. To szczególnie ważne przy słabym świetle i nagrywaniu wideo.

Co to oznacza dla Ciebie

Jeśli kupujesz smartfona z myślą o fotografii, nie sugeruj się wyłącznie liczbą megapikseli. Zamiast tego zwróć uwagę na kilka bardziej istotnych parametrów.

Na co zwrócić uwagę przy zakupie

- Wielkość sensora głównego - szukaj informacji o przekątnej sensora. Im większa, tym lepiej. Sensory 1/1,3" lub większe oferują zauważalnie lepszą jakość przy słabym świetle.

- Stabilizację optyczną OIS - jest niezastąpiona przy słabym świetle i nagrywaniu wideo. Bez niej wiele zdjęć nocnych i filmów będzie rozmazanych.

- Jakość oprogramowania - telefony Apple, Google i Samsung oferują najlepsze algorytmy obliczeniowe. Nawet przy podobnym sprzęcie różnice mogą być ogromne.

- Rozmiar piksela - podawany w mikrometrach (µm). Najlepiej powyżej 1,2 µm, a w przypadku flagowców często spotykamy piksele o rozmiarze 1,4-1,9 µm.

Smartfonowy aparat to fascynujący przykład tego, jak ograniczenia fizyczne można pokonywać za pomocą inżynierii i sztucznej inteligencji. Dzięki temu urządzenie, które mieści się w kieszeni, potrafi tworzyć zdjęcia, o których dekadę temu mogliśmy tylko marzyć.

Więcej o tym temacie

Przeczytaj pełny artykuł w źródle, aby dowiedzieć się więcej:

Czytaj więcej w Tech po ludzkuNajczęściej zadawane pytania

Czy ten artykuł był pomocny?

Powiązane artykuły

Czym jest ekran OLED i dlaczego czarny kolor jest tak czarny

Czarny kolor na ekranie OLED jest naprawdę czarny, a nie tylko ciemnoszary. W tym artykule wyjaśniamy bez zbędnego żargonu, jak działa ta technologia i dlaczego zmieniła sposób, w jaki oglądamy filmy oraz korzystamy ze smartfonów.

Dlaczego słuchawki Bluetooth mają opóźnienie i jak je zmniejszyć

Czy zdarzyło Ci się, że dźwięk w słuchawkach Bluetooth nie zgrywał się z ruchem ust w filmie? Wyjaśniamy, skąd bierze się to opóźnienie i jakie kroki możesz podjąć, aby cieszyć się płynnym dźwiękiem bez irytujących lagów.

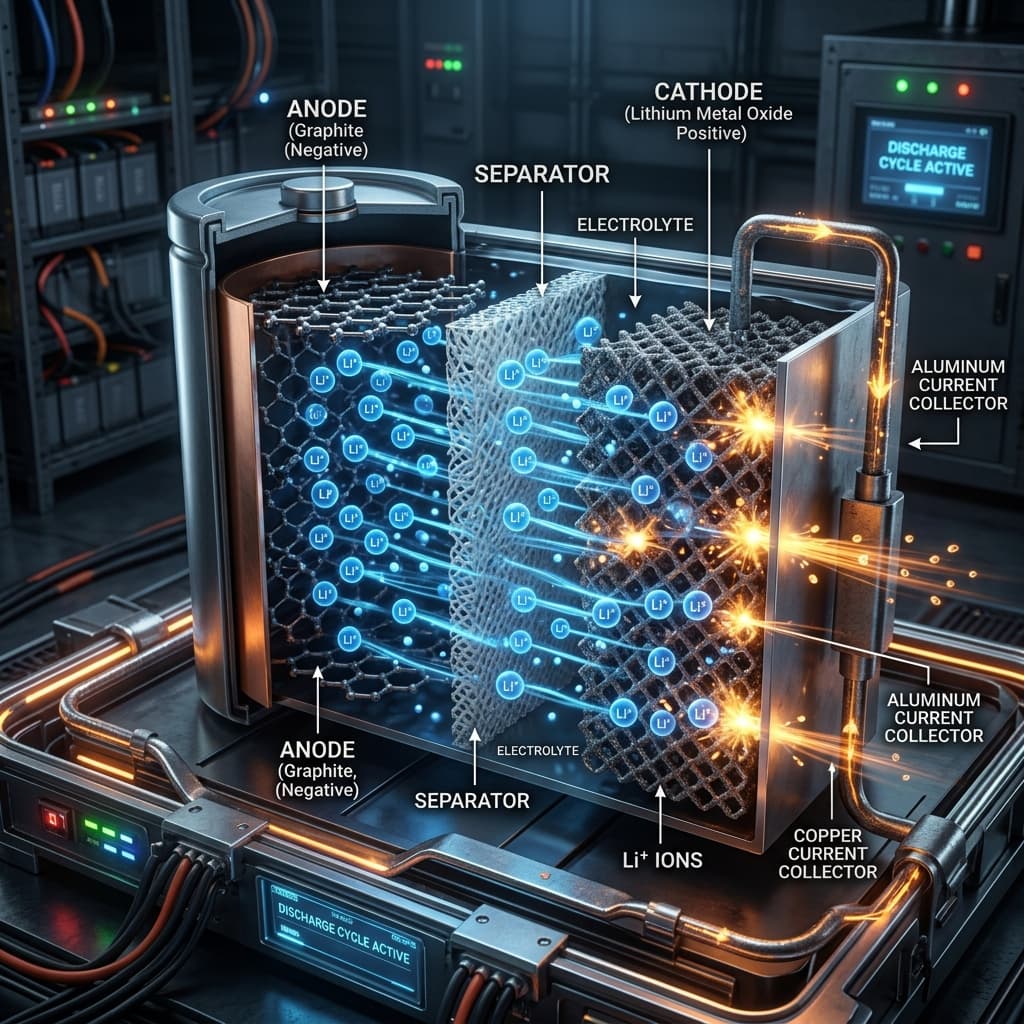

Jak działa bateria litowo-jonowa i dlaczego się zużywa

Bateria litowo-jonowa zasila niemal każdy smartfon, laptop i słuchawki, które posiadamy. W tym artykule wyjaśniamy w prosty sposób, co dzieje się wewnątrz takiej baterii i dlaczego z czasem traci ona swoją pojemność.